蘋果 機(jī)器人 新突破:賦予機(jī)器人“靈動(dòng)”手勢(shì),和人類一樣有魅力

人與人之間的交流,除了語言,還可以通過手勢(shì)、面部表情和身體語言傳遞更多的信息。同樣,機(jī)器人在與人類互動(dòng)時(shí),如果能夠通過合適的手勢(shì)和動(dòng)作來表達(dá)情感,互動(dòng)就會(huì)變得更加流暢和自然。

在現(xiàn)階段,機(jī)器人雖然能夠執(zhí)行一些簡單的手勢(shì)動(dòng)作,但這些動(dòng)作通常是預(yù)設(shè)的,缺乏靈活性,無法根據(jù)不同的社交情境做出合適的反應(yīng)。

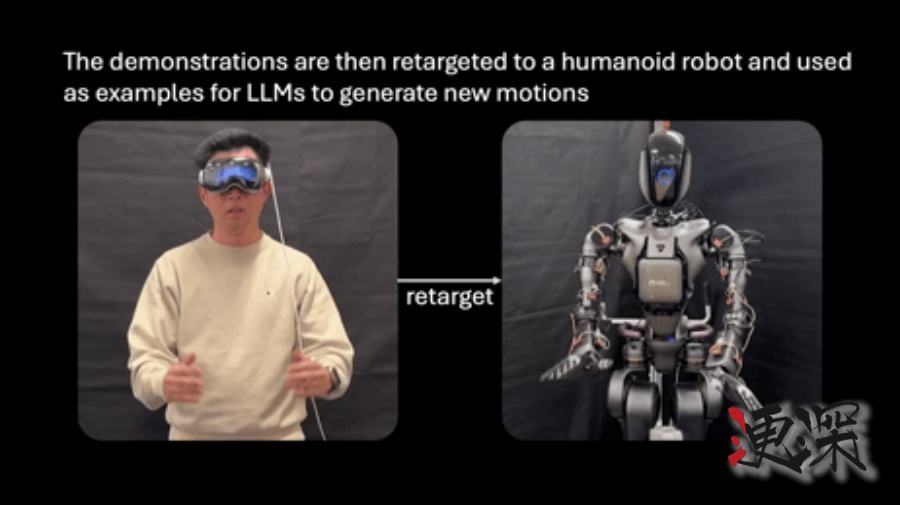

為了讓人形機(jī)器人能夠“讀懂”動(dòng)作,并且做動(dòng)作時(shí)更自然,Apple AIML研究人員Peide Huang在2024年10月的論文中提出了EMOTION框架。近期,該論文獲得了業(yè)界的廣泛關(guān)注。EMOTION框架通過大型語言模型(LLM)和視覺語言模型(VLM),幫助機(jī)器人生成自然且符合情境的手勢(shì)動(dòng)作。

這樣,機(jī)器人不僅能夠做出“豎大拇指”或“揮手”等簡單手勢(shì),還能根據(jù)不同的交流環(huán)境做出動(dòng)態(tài)、富有表現(xiàn)力的手勢(shì),提升與人類的互動(dòng)體驗(yàn)。

01 EMOTION框架,讓機(jī)器人也能為你豎起“大拇指”點(diǎn)贊

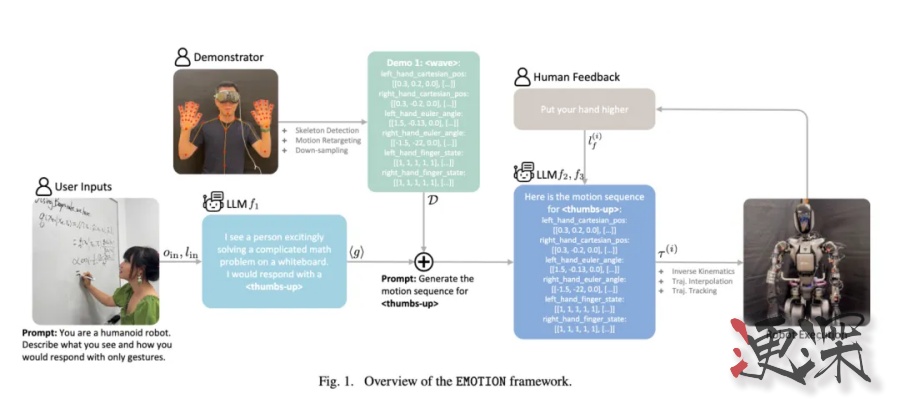

EMOTION利用大型語言模型(LLM)和視覺語言模型(VLM),讓機(jī)器人能夠理解并生成符合社交情境的手勢(shì)。

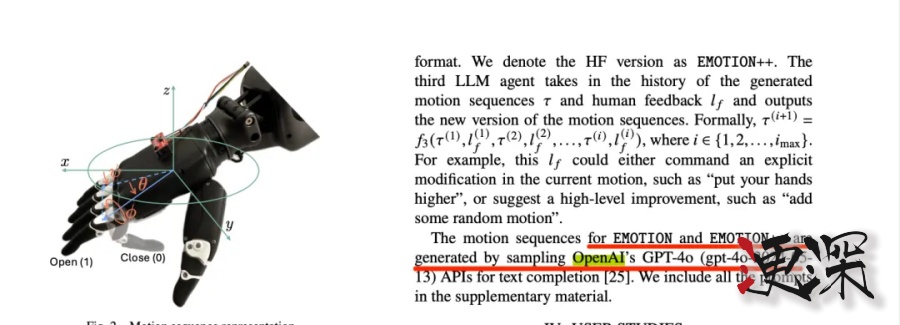

根據(jù)蘋果發(fā)表的論文顯示,EMOTION框架大語言模型主要用于動(dòng)作生成序列,通過調(diào)用OpenAI GPT-4的API進(jìn)行文本補(bǔ)全來實(shí)現(xiàn);VLM 主要使用的是Vision Transformers技術(shù),幫助機(jī)器人從圖像中提取重要信息,比如 3D 關(guān)鍵點(diǎn),如同人眼憑借識(shí)別物體形狀來理解其信息,機(jī)器人也能借助這種技術(shù)解讀圖片中的信息。

這些模型如同機(jī)器人的“社交大腦”。當(dāng)機(jī)器人看到某個(gè)情景或接收到語言指令時(shí),框架會(huì)通過“學(xué)習(xí)”這些信息,迅速生成合適的動(dòng)作。

例如,看到某個(gè)人正在解題,機(jī)器人會(huì)自動(dòng)做出一個(gè)“豎大拇指”的手勢(shì),以表達(dá)鼓勵(lì)和支持。

這種能力的核心,在于機(jī)器人能根據(jù)社交環(huán)境自動(dòng)“判斷”最合適的動(dòng)作,而不是依賴于預(yù)設(shè)的、固定的程序。

(EMOTION框架下機(jī)器人的環(huán)境判斷)

那么,EMOTION是如何做到這一點(diǎn)的呢?

其實(shí),它的工作流程就像是一個(gè)高度智能化的“手勢(shì)工廠”。

首先,機(jī)器人會(huì)通過“上下文學(xué)習(xí)”,即理解當(dāng)前情境所傳達(dá)的情感和信息。當(dāng)機(jī)器人接收到社交情境的輸入時(shí),比如一個(gè)語言指令,或者是機(jī)器人對(duì)周圍環(huán)境的視覺觀察,它會(huì)根據(jù)這些理解,通過模型生成符合情境的動(dòng)作序列,就像畫家根據(jù)不同的題材創(chuàng)作出各具風(fēng)格的作品。

這一過程的關(guān)鍵在于動(dòng)態(tài)生成。與傳統(tǒng)的預(yù)設(shè)手勢(shì)不同,EMOTION能夠根據(jù)每一次交互的獨(dú)特情境,生成與之最匹配的手勢(shì)。例如,機(jī)器人可能會(huì)因?yàn)椴煌那榫w表達(dá)或任務(wù)需求,做出不同的手勢(shì),而不是重復(fù)固定的動(dòng)作。這使得機(jī)器人不僅是一個(gè)簡單的“執(zhí)行者”,更像是一個(gè)可以與人類進(jìn)行富有表現(xiàn)力對(duì)話的伙伴。

其次,盡管EMOTION本身已能夠生成多樣化的手勢(shì),但人類的反饋仍然是提升互動(dòng)質(zhì)量的關(guān)鍵。通過引入EMOTION++版本,機(jī)器人能夠在與人類的互動(dòng)中,學(xué)習(xí)和調(diào)整自己的表現(xiàn)。這個(gè)過程就像是一個(gè)藝術(shù)家不斷在作品上進(jìn)行打磨,直到它達(dá)到了更為自然和合適的效果。

(EMOTION框架下,機(jī)器人在人類反饋之下的手勢(shì)互動(dòng))

在這個(gè)過程中,人類可以通過反饋告訴機(jī)器人哪些動(dòng)作看起來更自然、哪些手勢(shì)更易于理解。例如,假如機(jī)器人做出一個(gè)“聽”的手勢(shì),但這個(gè)手勢(shì)的手臂位置不夠直觀,可能讓人誤解為“停止”或“擁抱”,那么通過人類的調(diào)整建議,機(jī)器人可以優(yōu)化這個(gè)手勢(shì),最終呈現(xiàn)出更加合適的表達(dá)。

通過這種人類反饋的持續(xù)優(yōu)化,機(jī)器人生成的動(dòng)作變得更加符合人類的期望和社交習(xí)慣,從而提升了機(jī)器人在互動(dòng)中的自然性和可理解度。最終,EMOTION框架不僅使機(jī)器人能夠做出正確的手勢(shì),還能使它們?cè)谂c人類交流時(shí)表現(xiàn)得更富有“情感”和“智慧”。

02 手勢(shì)魅力大比拼:機(jī)器人 VS 人類

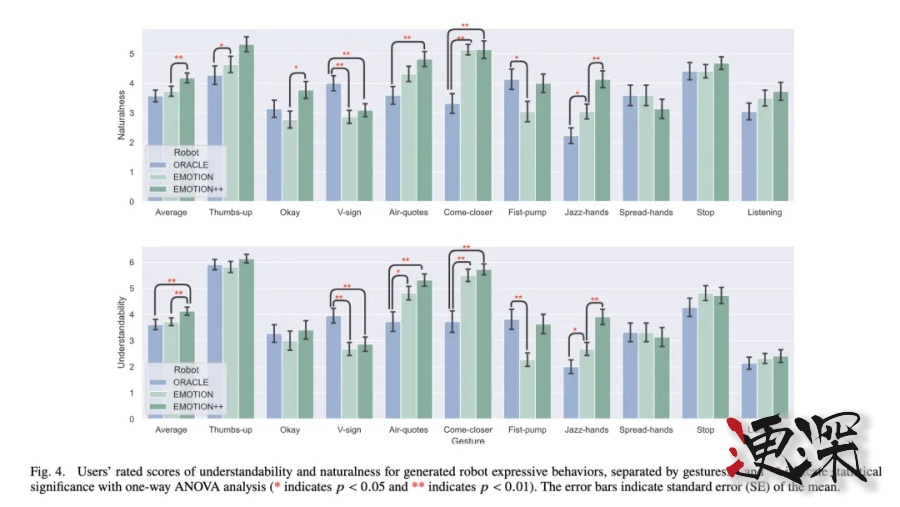

為了驗(yàn)證EMOTION框架的有效性,研究團(tuán)隊(duì)設(shè)計(jì)了一項(xiàng)用戶研究,目的就是對(duì)比EMOTION生成的手勢(shì)與人類親自表演的手勢(shì)在自然性和理解度上的差異。

這就像是在評(píng)選誰的“表演”更具魅力——是機(jī)器人還是人類?

在實(shí)驗(yàn)中,參與者觀看了由機(jī)器人和人類演示的手勢(shì)視頻,然后對(duì)這些手勢(shì)的自然性和可理解性進(jìn)行了評(píng)分。結(jié)果顯示,EMOTION生成的手勢(shì)與人類手勢(shì)之間并沒有顯著的差異。簡而言之,機(jī)器人做的手勢(shì)在大多數(shù)情況下與人類的動(dòng)作一樣自然、容易理解。

(用戶對(duì)生成的機(jī)器人表現(xiàn)性行為的可理解性和自然性的評(píng)分,按手勢(shì)分類。*和**表示統(tǒng)計(jì)學(xué)意義,其中*表示p < 0.05,**表示p < 0.01。誤差條表示均值的標(biāo)準(zhǔn)誤差(SE))

(ORACLE:表示由人類示范的手勢(shì),是實(shí)驗(yàn)中的對(duì)比組,作為參考。EMOTION:表示由EMOTION框架生成的手勢(shì),基于大型語言模型(LLM)和視覺語言模型(VLM)進(jìn)行生成的機(jī)器人手勢(shì)。EMOTION++:表示通過EMOTION框架生成的手勢(shì),但在此基礎(chǔ)上引入了人類反饋(優(yōu)化版本),以進(jìn)一步提升手勢(shì)的自然性和可理解度。)

然而,盡管EMOTION表現(xiàn)良好,它仍有一些不足,特別是在某些細(xì)節(jié)的處理上。部分手勢(shì),尤其是更為復(fù)雜或細(xì)膩的動(dòng)作,仍需要進(jìn)一步的優(yōu)化和調(diào)整。

那么,是什么影響了這些手勢(shì)的自然性和理解度呢?

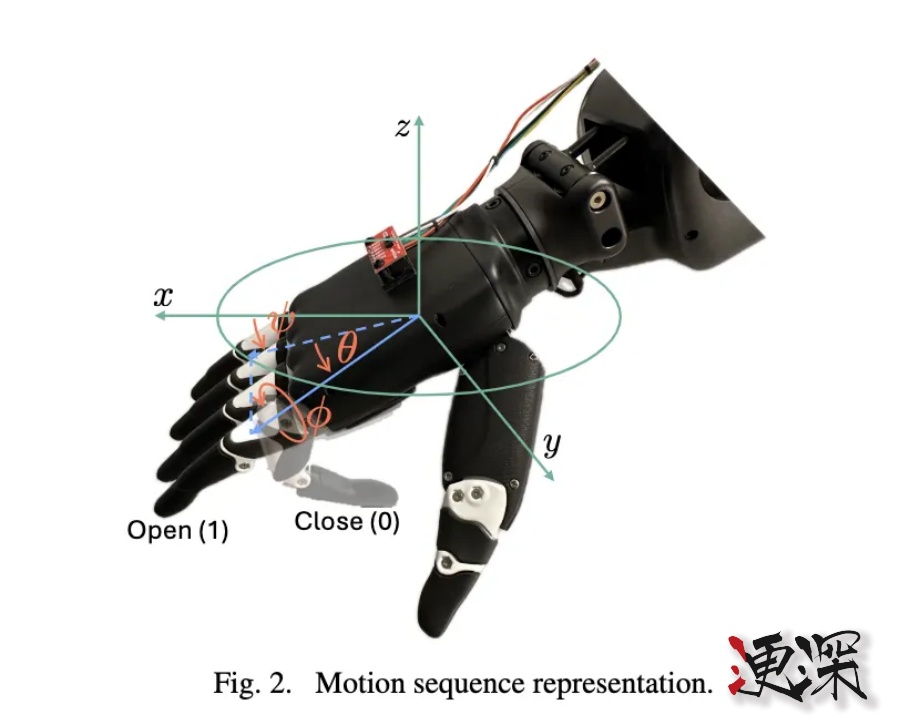

第一點(diǎn),研究表明,手勢(shì)的細(xì)節(jié)在這其中起著至關(guān)重要的作用,也就是硬件限制。

比如,當(dāng)前的機(jī)器人硬件可能無法靈活地模擬所有細(xì)膩的手勢(shì)。例如,手的位置和手指的姿勢(shì)直接決定了手勢(shì)是否能夠準(zhǔn)確傳達(dá)意圖。就像你在用手勢(shì)傳達(dá)“OK”時(shí),如果手指的彎曲程度不對(duì),別人可能會(huì)誤解成“歪了的OK”或者完全不理解你的意圖。

(機(jī)械手的運(yùn)動(dòng)序列)

第二點(diǎn),動(dòng)作模式也起到了重要作用。想象一下,如果你讓機(jī)器人做一個(gè)“停止”的手勢(shì),動(dòng)作的“流暢性”和“直觀性”決定了觀眾能否立刻理解這個(gè)動(dòng)作。如果動(dòng)作過于生硬,或是路徑不夠直接,就容易造成誤解。因此,EMOTION需要精細(xì)調(diào)整手勢(shì)的流暢度和準(zhǔn)確度,確保每一個(gè)動(dòng)作都能迅速且準(zhǔn)確地傳達(dá)出正確的信息。

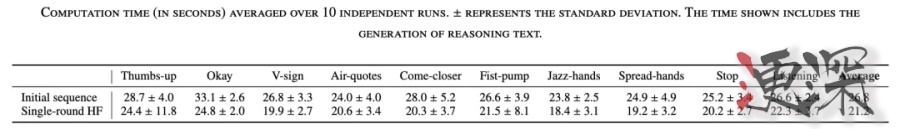

第三點(diǎn),計(jì)算時(shí)間是挑戰(zhàn)。生成每個(gè)動(dòng)作序列需要一定的時(shí)間,而目前的計(jì)算速度可能不能滿足實(shí)時(shí)互動(dòng)的需求。為了讓機(jī)器人能夠像人類一樣在自然對(duì)話中快速做出反應(yīng),計(jì)算時(shí)間需要進(jìn)一步減少。

(通過多次運(yùn)行實(shí)驗(yàn),計(jì)算了每次生成手勢(shì)所需的平均時(shí)間,并考慮了計(jì)算中可能的波動(dòng)(標(biāo)準(zhǔn)差);Initial sequence(初始序列),Single-round HF(單輪人類反饋))

通過實(shí)驗(yàn)統(tǒng)計(jì)顯示:

第一,生成初始動(dòng)作序列的時(shí)間普遍較長。例如,對(duì)于“Thumbs-up”手勢(shì),初始序列生成的時(shí)間為28.7秒,而其他手勢(shì)的時(shí)間也大致在24秒到33秒之間。這表明,機(jī)器人在初次生成動(dòng)作時(shí),需要較多的計(jì)算和處理時(shí)間。

第二,在加入人類反饋后,計(jì)算時(shí)間普遍縮短。例如,“Thumbs-up”手勢(shì)在人類反饋后的時(shí)間降至24.4秒,相較于初始生成的時(shí)間,明顯減少。這意味著,通過人類反饋優(yōu)化手勢(shì)序列后,機(jī)器人能夠更高效地調(diào)整和改進(jìn)動(dòng)作。

面對(duì)這些挑戰(zhàn),未來的解決方向包括優(yōu)化硬件設(shè)計(jì),提升機(jī)器人的關(guān)節(jié)和手指靈活性;同時(shí),加速計(jì)算過程,利用更高效的算法和本地化計(jì)算,縮短響應(yīng)時(shí)間。

隨著EMOTION框架的進(jìn)一步發(fā)展,機(jī)器人不僅能在實(shí)驗(yàn)環(huán)境中表現(xiàn)出色,還可以在不同的應(yīng)用場景中發(fā)揮更大的潛力。例如,家庭助手、教育機(jī)器人、醫(yī)療機(jī)器人等,未來都能借助EMOTION框架,進(jìn)行更加自然和富有表現(xiàn)力的互動(dòng)。